🧠 从大模型到垂域小模型:模型蒸馏全流程实战指南

原创在大模型(LLM)时代,很多开发者都面临一个现实问题:

👉 大模型很强,但太贵、太慢、不可控

👉 小模型很轻,但能力不够、泛化差

于是,一个关键技术浮出水面:模型蒸馏(Model Distillation)

这篇文章我会用工程实践视角,带你从0到1走完整个流程,包括:

蒸馏原理(不仅是概念)

数据构造方法(最核心)

训练流程(可落地)

常见坑点

实战架构设计

适合:有编程基础的开发者 / AI产品工程师 / 独立开发者

一、什么是模型蒸馏?(一句话讲清楚)

模型蒸馏 = 用一个“大模型老师”,教一个“小模型学生”

更具体一点:

用大模型生成高质量“答案/推理过程”,再训练小模型去模仿这些能力。

为什么蒸馏很重要?

因为它解决了3个核心问题:

| 问题 | 大模型 | 小模型 | 蒸馏后 |

|---|---|---|---|

| 成本 | 高 | 低 | 低 |

| 延迟 | 高 | 低 | 低 |

| 能力 | 强 | 弱 | 接近大模型 |

👉 本质:用一次大模型成本,换长期低成本推理能力

二、蒸馏的核心原理(不是“喂数据”那么简单)

很多人以为蒸馏就是:

用大模型生成数据 → 拿去训练小模型

❌ 其实不够

真正的蒸馏包含三个层次:

1️⃣ 输出蒸馏(Output Distillation)

最基础的一种:

输入:用户问题

输出:大模型回答

训练小模型去拟合:

P_student(y|x) ≈ P_teacher(y|x)

👉 适合:简单问答、分类、生成任务

2️⃣ 软标签蒸馏(Soft Label)

不是只学“答案”,而是学“概率分布”

比如:

大模型输出:

A: 0.7

B: 0.2

C: 0.1

👉 小模型学习“思考倾向”,而不是死答案

3️⃣ 思维链蒸馏(CoT Distillation)🔥

这是现在最关键的蒸馏方式:

问题 → 推理过程 → 答案

例如:

Q: 2+3*4=?

CoT: 先乘法 3*4=12,再加2=14

A: 14

👉 小模型不仅学结果,还学“思考方式”

三、完整蒸馏流程(工程视角)

下面是一个标准工业级流程:

🔧 Step 1:确定任务边界(非常关键)

你要先明确:

是做客服?

医疗问答?

法律分析?

SQL生成?

👉 蒸馏 ≠ 通用模型复制

👉 蒸馏 = 垂直领域能力压缩

📊 Step 2:构造蒸馏数据集(核心中的核心)

数据质量决定上限。

数据来源有3种:

① 人类标注数据(高质量)

用户问题 + 标准答案

优点:准确

缺点:贵

② 大模型生成数据(主流)

流程:

Prompt → 大模型 → 输出

示例:

请以法律专家身份回答:

……

③ 真实用户日志(最有价值)

用户输入 → 系统输出 → 用户反馈

👉 可以筛选高质量样本用于蒸馏

🧠 Step 3:设计 Prompt(决定数据质量)

关键点:

角色设定(专家/老师)

输出格式(JSON / CoT)

风格约束

示例:

你是一个资深财务顾问,请逐步推理并给出答案:

👉 直接影响小模型能力上限

⚙️ Step 4:生成蒸馏数据

批量调用大模型:

for sample in dataset:

response = teacher_model(prompt(sample))

建议:

多样化 Prompt(避免过拟合)

多轮生成(提高鲁棒性)

🧹 Step 5:数据清洗与过滤

必须做!否则小模型会学“垃圾”

过滤规则:

去重复

去错误答案

去无逻辑推理

长度裁剪

🏋️ Step 6:训练小模型(Student)

常见方案:

方案1:SFT(监督微调)

输入 → 输出

适合:

快速上线

数据质量高

方案2:蒸馏损失训练(进阶)

损失函数:

Loss = α * CE_loss + β * KL_loss

👉 同时学习:

正确答案

大模型分布

方案3:LoRA 微调(低成本)

优点:

显存占用低

适合独立开发者

🚀 Step 7:评估与迭代

指标:

准确率

BLEU / ROUGE

人类评分

业务指标(转化率)

👉 蒸馏是一个持续优化过程

四、蒸馏系统架构(实战推荐)

下面是一个典型架构:

用户数据 → 数据清洗 → Prompt工程

↓

大模型生成(Teacher)

↓

数据过滤 + 标注增强

↓

小模型训练(Student)

↓

部署推理

推荐技术栈(适合独立开发者)

| 模块 | 技术 |

|---|---|

| 数据处理 | Python / Pandas |

| 调用大模型 | API(OpenAI / Claude / 本地LLM) |

| 训练 | PyTorch / Transformers |

| 微调 | LoRA / PEFT |

| 部署 | FastAPI + Docker |

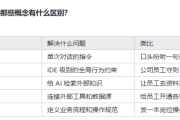

五、蒸馏 vs 微调 vs RAG(对比表)

很多人会混淆这三种方案:

| 方案 | 本质 | 优点 | 缺点 |

|---|---|---|---|

| 蒸馏 | 能力迁移 | 成本低、推理快 | 前期成本高 |

| 微调 | 参数优化 | 简单直接 | 泛化有限 |

| RAG | 外部知识 | 实时更新 | 依赖检索 |

👉 实战建议:

蒸馏 + RAG = 最优解

六、实战案例:做一个“客服小模型”

目标:

👉 替代大模型客服,降低成本

步骤拆解:

1️⃣ 收集数据

FAQ

客服记录

用户问题

2️⃣ 用大模型增强

输入:用户问题

输出:专业客服回答 + 推理过程

3️⃣ 蒸馏训练

使用LoRA

小模型(7B / 3B)

4️⃣ 上线部署

API服务

接入聊天系统

👉 成果:

成本下降 80%+

响应速度提升 3倍+

七、常见坑(非常重要)

❌ 1:数据质量差

👉 垃圾进 → 垃圾出

❌ 2:过拟合 Prompt 风格

小模型变成“模板复读机”

❌ 3:忽略推理过程

👉 只蒸馏答案,能力提升有限

❌ 4:评估不真实

👉 必须用真实业务数据

八、进阶玩法(高手向)

如果你想再往上走,可以尝试:

🔥 1:多教师蒸馏

GPT + Claude + 自研模型

👉 融合能力更强

🔥 2:自蒸馏(Self Distillation)

模型自己教自己

🔥 3:在线蒸馏(持续学习)

用户数据 → 实时训练

👉 SaaS 产品核心能力

九、总结(一句话带走)

模型蒸馏的本质,是把“大模型的能力压缩成你自己的生产力工具”。

如果你是独立开发者,这是一条非常现实的路径:

👉 用大模型赚钱

👉 用蒸馏降低成本

👉 用小模型做产品壁垒

微信扫一扫,打赏作者吧~

微信扫一扫,打赏作者吧~版权声明

如有错误或侵权,请联系我修改或删除,QQ374060。

哈溜

哈溜