🧠 从 Prompt 到 Context,再到 Harness:AI 开发进入“系统工程时代”

原创过去三年,AI开发经历了一次非常清晰、甚至可以说是“范式级”的演进:

Prompt → Context → Harness

如果你还停留在写提示词、调参数,那你其实已经落后一个时代了。

今天我们重点讲清楚一个关键词——Harness Engineering(驾驭工程)

它,才是未来三年的主战场。

🐎 一、什么是 Harness?先别急着理解技术

先理解一个画面:

你有一匹马——

它很强、很快、很聪明,但有个问题:

👉 它不太听话。

这匹马,就是 AI Agent。

而 Harness 是什么?

Harness = 马具(缰绳 + 马鞍 + 控制系统)

它的作用不是让马更强,而是:

👉 让马在正确的方向上稳定地强。

换句话说:

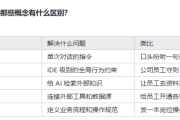

| 阶段 | 本质 |

|---|---|

| Prompt Engineering | 你在“说话” |

| Context Engineering | 你在“喂信息” |

| Harness Engineering | 你在“造一个世界让AI工作” |

🔥 二、为什么 Prompt 已经过时了?

先说一句扎心的:

👉 Prompt Engineering 从来不是“工程”,它只是“技巧”。

你可以写出很漂亮的 Prompt,比如:

“请你作为一个资深工程师…”

“请一步一步推理…”

“请确保输出 JSON 格式…”

这些都有效,但问题是:

❗ 一旦任务复杂,它就崩了

为什么?

因为 Prompt 有三个天然限制:

上下文有限

不可控(模型仍可能胡来)

不可复用(每次都像在赌)

所以 2025 年大家开始转向:

👉 Context Engineering(上下文工程)

🧩 三、Context Engineering:让 AI “看更多”

这一阶段的核心是:

不再只优化一句话,而是设计整个输入环境

包括:

系统提示(System Prompt)

对话历史(Chat History)

长期记忆(Memory)

RAG(检索增强)

工具调用结果(Tool Output)

一句话总结:

👉 你不是在写 Prompt,而是在“编排信息流”

但问题来了:

❗ Context 再强,也解决不了一个问题:

AI 还是会犯错,而且是重复犯错。

🚨 四、Harness Engineering 出现的根本原因

这是关键中的关键:

👉 AI 的问题不是“不会做”,而是“做错还不长记性”

举几个真实例子:

JSON 输出格式偶尔错

SQL 写对 90%,但有 10% 错误

工具调用参数漏字段

代码能跑,但边界条件没处理

你会发现:

👉 这些错误不是“能力问题”,是“系统问题”。

于是 Mitchell Hashimoto 提出了一个非常关键的思想:

每当 AI 犯一个错误,不要修 Prompt,而是修系统。

这就是 Harness Engineering 的核心。

🧠 五、Harness Engineering 的本质是什么?

一句话总结:

把 AI 从“猜答案的黑盒”,变成“受控执行的系统组件”

它关注的不再是:

AI 怎么想

而是:

AI 必须怎么做

你可以把它理解为:

👉 AI 外面包了一层“操作系统”

⚙️ 六、Harness 的四大核心组件

我们把 Harness 拆开来看,它通常包含 4 个核心能力:

1️⃣ 验证闭环(Validation Loop)

这是 Harness 的核心中的核心。

🚫 传统方式:

AI 输出 → 用户看 → 发现错

✅ Harness方式:

AI 输出 → 自动验证 → 不通过 → 自动修复 → 再验证

比如:

{

"name": "张三",

"age": "twenty"

}

验证规则:

age 必须是数字

👉 Harness 自动:

检测错误

反馈给 AI

要求修复

再验证

这叫:

Self-healing Loop(自愈闭环)

2️⃣ 架构约束(Constraints)

你不再“建议”AI,而是“限制”AI。

比如:

必须输出 JSON Schema

必须调用指定工具

必须走固定流程(状态机)

👉 AI 不再是自由发挥,而是:

在轨道上运行

3️⃣ 生命周期管理(Lifecycle)

传统 AI:

👉 一次调用就结束

Harness:

👉 一个任务有完整生命周期:

Plan → Execute → Verify → Fix → Deliver

甚至可以做:

重试策略

超时控制

fallback 模型

这已经不是 Prompt 了,这是:

👉 工程系统

4️⃣ 熵清理(Entropy Control)

这是最容易被忽略、但最重要的一点。

AI 的本质是概率系统:

👉 每次输出都有“随机性”(熵)

Harness 的作用之一就是:

压低熵,让结果稳定

方法包括:

标准化输出

强结构(JSON / DSL)

多模型交叉验证

deterministic decoding

🧠 七、一个真实的 Harness 架构

我给你一个非常实用的结构:

用户请求

↓

Planner(规划任务)

↓

Executor(调用AI执行)

↓

Validator(验证结果)

↓

Fixer(修复错误)

↓

Final Output

每一层都可以工程化:

Planner:拆任务

Executor:调用 GPT / 工具

Validator:规则 + schema

Fixer:自动纠错

👉 这就是一个最小 Harness 系统。

🔥 八、Harness vs Agent:本质区别

很多人搞混这两个概念。

Agent:

👉 会思考、会行动

Harness:

👉 控制 Agent 的系统

换句话说:

Agent 是“马”,Harness 是“缰绳”

没有 Harness 的 Agent:

👉 很聪明,但不可靠

有 Harness 的 Agent:

👉 可以进生产环境

🚀 九、为什么说这是“未来三年的主战场”?

因为:

👉 Prompt 能写的人很多

👉 Context 会做的人也越来越多

但:

能做 Harness 的人,极少

而企业真正需要的是:

稳定

可控

可复用

可扩展

不是:

一次惊艳的 demo

Cassie Kozyrkov 说过一句很狠的话:

Vibe Coding 降低了语法门槛,但提高了系统思维门槛

翻译一下就是:

👉 写代码更简单了,但“设计系统”更难了

🧩 十、给你一个非常落地的建议(重点)

如果你是开发者 / 独立开发者 / AI产品人:

❌ 不要再只做这些:

写 Prompt

调 temperature

拼 RAG

✅ 你应该开始做:

1. 写 Validator(规则系统)

JSON Schema

正则校验

业务规则

2. 做自动修复(Auto Fix)

失败 → 反馈 → 再生成

3. 设计执行流程

多步任务拆解

状态机

4. 做“失败即优化”

每一次 AI 出错:

👉 不是改 Prompt,而是加一个机制

🧠 最后总结一句话

Prompt 是沟通

Context 是信息

Harness 是系统

如果说过去三年你在“驯服语言模型”,

那么接下来三年,你要做的是:

驯服整个 AI 系统。

微信扫一扫,打赏作者吧~

微信扫一扫,打赏作者吧~版权声明

如有错误或侵权,请联系我修改或删除,QQ374060。

哈溜

哈溜